AIエージェント

1. AIエージェントは「自律的に計画し、外部ツールを用いて行動するソフトウェア」であり、2026年には実行主体として定義が拡張されている。

2. 歴史的には1950年代のGOFAIから始まり、LLMの登場とAutoGPT以降の進化により実用的な自律性を獲得した。

3. ビジネス、医療、開発、経済圏まで幅広く活用が進み、マルチエージェント化とガバナンスが2026年の主要トレンドとなっている。

1. 用語の定義

AIエージェント(Artificial Intelligence Agent)とは、特定の目標を達成するために、周囲の環境を認識し、自律的に計画を立て、外部ツールを用いて行動を実行するソフトウェアエンティティを指します。2026年現在の技術的コンセンサスにおいて、AIエージェントは単なる「応答マシン」から「実行主体」へと定義が拡張されています。

1.1 核心的な定義と3つの構成要素

AIエージェントを定義する際、学術的および産業的な視点から、以下の3つの要素が不可欠であるとされています。

- 自律性(Autonomy): 人間からの逐一の指示を待たず、設定された目標(ゴール)に基づき、自ら次に行うべきアクションを決定する能力。

- 環境認識(Perception): ソフトウェア環境(API、データベース、Web)や物理環境(センサー、カメラ)からの入力を通じ、現在の状況を正確に把握する能力。

- 実行能力(Agency): 思考するだけでなく、実際にブラウザを操作する、コードを実行する、メールを送信するなど、環境に対して変化をもたらす能力。

AWS(Amazon Web Services)の定義によれば、「AIエージェントは目標によって駆動され、その行動は効用関数またはパフォーマンス指標によって定義される成功の最大化を目的とする」とされています。これは、従来のプログラムが「If-Then」の固定ルールで動くのに対し、AIエージェントは「何が最善の結果か」を自ら計算して動くことを意味します。

1.2 生成AI(LLM)との決定的相違点

2023年以降に普及した一般的な「生成AI(ChatGPT等)」と「AIエージェント」は、しばしば混同されますが、その本質は「反応的」か「能動的」かにあります。以下の表にその主要な違いを整理します。

| 項目 | 生成AI(チャットボット) | AIエージェント |

|---|---|---|

| 動作原理 | ユーザーのプロンプトに対する「反応」 | 目標達成のための「自律的行動」 |

| 主な出力 | テキスト、画像、音声などのコンテンツ | タスクの完了(予約、決済、更新など) |

| 指示の細かさ | 具体的な手順が必要 | 最終目標(ゴール)の提示だけで機能 |

| ツールの利用 | 限定的(モデル内部で完結) | 外部API、ブラウザ、アプリを自在に操作 |

1.3 2026年における最新の定義:エージェンティック・ワークフロー

現在、専門家の間では「エージェンティック・ワークフロー(Agentic Workflow)」という概念が重視されています。これは、AIが一気に回答を出すのではなく、「計画→実行→反省(セルフリフレクション)→修正」というサイクルを繰り返すプロセスを指します。これにより、従来のLLMが抱えていた「幻覚(ハルシネーション)」を大幅に抑制し、実務に耐えうる精度を確保することが可能となりました。

1.4 自律性のレベル分け

AIエージェントの自律性は、自動車の自動運転と同様にレベル分けして理解することが一般的です。

- レベル1:支援型(人間の指示を補完し、草案を作成する)

- レベル2:半自律型(タスクを分解し、人間に承認を求めながら実行する)

- レベル3:高度自律型(特定の権限範囲内で、意思決定と実行を完結させる)

- レベル4:完全自律型(目標設定から手段の選択、結果の評価までをAIが行う)

2026年現在、多くの先進企業が導入を進めているのは「レベル2からレベル3」の段階であり、人間による最終確認(Human-in-the-loop)を組み込んだ設計が推奨されています。

このように、AIエージェントは単なる「便利な辞書」ではなく、デジタル空間における「自律的な労働力」として定義されています。この定義の理解こそが、次章で述べる歴史的背景や最新の政策議論を読み解く鍵となります。

2. 用語の背景と歴史

AIエージェントの概念は、決して新しいものではありません。その起源は1950年代の人工知能黎明期にまで遡りますが、現代のような「実用的な自律性」を獲得するまでには、いくつかの重要な技術的ブレイクスルーとパラダイムシフトが必要でした。

2.1 初期のエージェント研究(1950年代 – 1980年代)

初期のAI研究において、エージェントは「環境の中で合理的に行動する実体」として理想化されていました。1950年代、アラン・チューニングやジョン・マッカーシーらは、機械が人間のように思考し行動する可能性を論じました。しかし、当時の技術では「IF-THEN」形式の厳格なルールに基づいた制御が限界であり、想定外の事態に柔軟に対応することは不可能でした。これが「GOFAI(Good Old Fashioned AI:古き良きAI)」と呼ばれる時代です。

2.2 自律型エージェントの理論的確立(1990年代)

1990年代に入ると、マルチエージェントシステム(MAS)の研究が盛んになります。個々の知能は限定的でも、複数のエージェントが通信し、協調・交渉することで複雑な問題を解決するという理論です。また、スチュアート・ラッセルとピーター・ノーヴィグによる名著『エージェントアプローチ 人工知能』が出版され、AIを「合理的なエージェントの設計」として体系化したことが、現代の定義の基礎となりました。

2.3 ディープラーニングと強化学習の融合(2010年代)

2010年代、深層学習(ディープラーニング)の爆発的進化により、エージェントは「認識」の壁を突破しました。特にGoogle DeepMindによる「AlphaGo」の成功は、強化学習(Reinforcement Learning)を用いることで、エージェントが自己対局を通じて最適な行動を学習できることを証明しました。しかし、この時期のエージェントはゲームや特定の物理制御など、極めて限定された「狭い領域(Narrow AI)」でのみ機能するものでした。

2.4 2023年:LLMによる「脳」の獲得と「AIエージェント元年」

最大の転換点は、2023年の大規模言語モデル(LLM)の一般普及です。GPT-4のようなモデルが登場したことで、AIは初めて「高度な推論能力」と「共通言語による指示の理解」という強力な「脳」を手に入れました。

2023年4月に登場した「AutoGPT」や「BabyAGI」というオープンソースプロジェクトは、LLMに「自分自身でプロンプトを生成させ、それを実行し続ける」というループを組み込み、世界中に衝撃を与えました。これが「AIエージェント元年」の号砲となりました。

2.5 2025年 – 2026年:実行のフェーズと「人工知能基本計画」

2025年、日本政府は「AI事業者ガイドライン(第1.1版)」を公表し、AIエージェントの適正な利用とリスク管理の枠組みを提示しました。そして2025年12月に閣議決定された「人工知能基本計画」により、2026年は「日本再起」に向けた社会実装の年と位置づけられました。

現在(2026年2月)のトレンドは、単一のエージェントが動く段階から、複数の専門エージェントが連携する「マルチエージェント・オーケストレーション」へと移行しています。また、物理的なロボットと融合した「フィジカルAI」の研究も、政府主導で戦略的に推進されています。

2.6 歴史的課題:ハルシネーションと制御の困難性

歴史を振り返ると、常に課題となってきたのは「制御可能性(Controllability)」です。自律性を高めれば高めるほど、AIが予期せぬ行動をとるリスクが増大します。1990年代には「計算資源の不足」が壁でしたが、2020年代後半の課題は「安全性(Alignment)」と「エネルギー効率」に集約されています。2026年の現在、これらの課題に対して「思考連鎖(Chain-of-Thought)」や「形式検証(Formal Verification)」といった技術が解決策として提示され始めています。

3. 用法と具体例

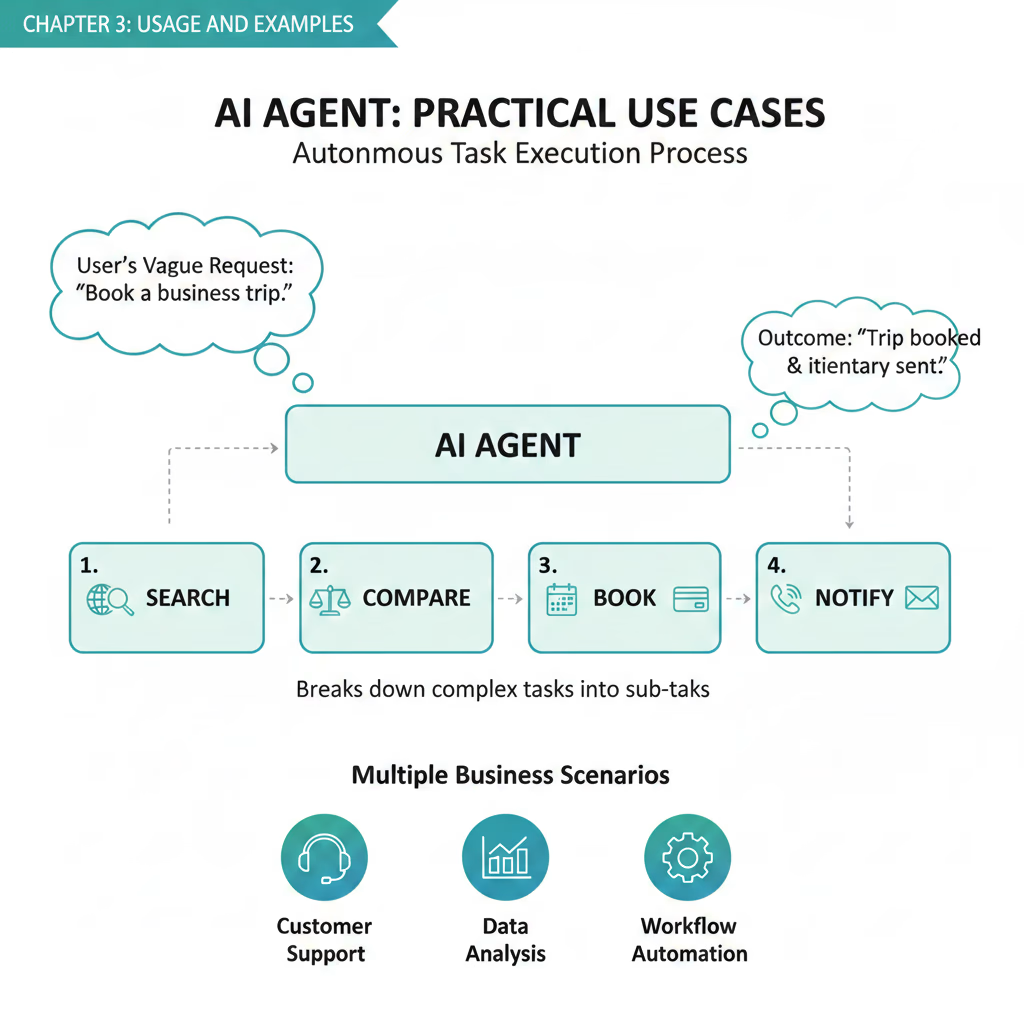

AIエージェントは、特定の産業に留まらず、バックオフィス業務から高度な専門職、さらには日常生活のパーソナルアシスタンスまで、極めて広範な領域で活用されています。ここでは、2026年現在の代表的な用法と、具体的かつ詳細なユースケースを紹介します。

3.1 ビジネスプロセス・オートメーション(BPA)

従来のRPA(Robotic Process Automation)が「決まった手順の繰り返し」だったのに対し、AIエージェントは「非定型な情報の処理」を得意とします。

- 請求書・経理処理: 異なるフォーマットの請求書をスキャンし、記載内容の矛盾(住所の不一致、税率計算のミス等)を自律的に検知。不明点は自ら取引先のAIエージェントへ照会メールを送り、解決した上で会計システムへ登録します。

- 採用業務のアシスタント: 候補者の履歴書をスキルマップと照合し、最適な面接時間を調整。過去の面接ログを分析して、面接官に「確認すべき深掘り質問」を提案します。

3.2 顧客対応とセールス

カスタマーサポート領域では、単なるFAQの返答から「問題解決の完結」へと役割が進化しています。

ガートナーのレポートによれば、2026年には「企業のカスタマー接点の40%がAIエージェントによって自律的に処理される」と予測されています。例えば、ECサイトの返品対応において、エージェントは顧客の購入履歴、返品理由の妥当性、現在の在庫状況を瞬時に判断し、代替品の発送手続きや返金処理を、人間の介入なしに数秒で完了させます。

3.3 専門職支援:医療・法務・開発

専門知識を必要とする分野では、AIエージェントは「有能な副操縦士(コパイロット)」として機能します。

- 医療現場(臨床決定支援): 患者のバイタルデータ、検査結果、論文データベースを統合解析し、医師に診断の可能性と推奨される治療計画を提示します。

- ソフトウェア開発(AIコーダー): 2026年の開発環境では、AIエージェントがバグ報告(Ticket)を自動的に解析し、修正コードを生成、テストを実行した上でプルリクエストを作成するまでを自律的に行います。

3.4 2026年の先端事例:AI経済圏での自律取引

日本政府の「人工知能基本計画」でも言及されている通り、エージェント同士が経済的価値をやり取りする事例が登場しています。

例えば、物流エージェントが燃料価格や配送ルートを最適化するために、電力エージェントとリアルタイムで電力購入価格を交渉し、最もコスト効率の良い時間帯に電気自動車(EV)の充電を行うといった「エージェント間交渉」が実用化されつつあります。

3.5 活用におけるワークフローの比較

AIエージェントを導入する前と後で、業務プロセスがどのように変化するかを以下の表に示します。

| フェーズ | 従来(手動+単純自動化) | AIエージェント導入後 |

|---|---|---|

| タスクの分解 | 人間が詳細な手順を設計する | AIが目標から必要な手順を自動算出 |

| 例外への対応 | エラーで停止し、人間が介入 | AIが理由を推論し、代替案を試行 |

| ツール間の連携 | API連携開発が必要 | AIが画面操作や自然言語でツールを跨ぐ |

| 学習と改善 | 人間がマニュアルを改訂 | 実行ログからAIが自己修正を行う |

これらの用法を支えているのは、単一の高度なLLMだけでなく、Web検索、コード実行、アプリ操作などの「ツール(Tools)」を適切に使いこなす能力です。この「思考(Reasoning)」と「道具の使用(Tool Use)」の融合が、AIエージェントを実用的なものにしています。

4. 関連語句と概念

AIエージェントの理解を深めるためには、その周辺を固める技術用語や概念を体系的に把握する必要があります。2026年の技術標準において頻出する重要なキーワードを解説します。

4.1 マルチエージェントシステム(MAS)

単一の「万能AI」を作るのではなく、特定のタスクに特化した複数のエージェントを連携させる仕組みです。例えば、「調査担当エージェント」「執筆担当エージェント」「校閲担当エージェント」が互いにフィードバックを出し合いながら1つのレポートを完成させます。これにより、単一モデルでは達成困難な高度な精度と複雑なワークフローが実現されます。

4.2 RAG(Retrieval-Augmented Generation)

「検索拡張生成」と呼ばれる技術です。AIエージェントが外部の信頼できるデータベースや社内文書を検索し、その情報を基に応答を生成する仕組みです。AIエージェントが「最新の事実」に基づいて行動するために不可欠な基盤技術であり、2026年現在は「GraphRAG(ナレッジグラフを活用したRAG)」への進化が進んでいます。

4.3 思考連鎖(Chain-of-Thought: CoT)

AIが結論を出す前に「中間的な思考ステップ」を書き出す手法です。エージェントが複雑な問題を解く際に、自身の思考プロセスを言語化することで、論理的ミスを減らし、人間がその判断根拠を検証(監査)しやすくする効果があります。

4.4 関数呼び出し(Function Calling)

AIが「いつ、どのツール(API)を呼び出すべきか」を判断する機能です。例えば、「現在の東京の気温を教えて」と言われた際、AIが自律的に「天気予報API」を選択し、必要なパラメータ(東京)を生成してデータを取得する仕組みを指します。

4.5 ガバナンスとアライメント(Alignment)

AIの行動を人間の意図や倫理基準に一致させることを指します。特に自律的に行動するエージェントにおいては、暴走を防ぐための「ガードレール」設定が重要です。日本政府の「AI事業者ガイドライン」でも、このアライメントの確保が事業者の責務として強調されています。

4.6 主要用語の相関関係

以下のリストは、AIエージェントを動かす「4つのエンジン」をまとめたものです。

- 推論エンジン: LLM(GPT-5, Gemini 3, Llama 4等)

- 記憶エンジン: ベクトルデータベース、コンテキストキャッシュ

- 行動エンジン: API、ブラウザ操作エージェント、ロボットOS

- 管理エンジン: エージェント・オーケストレーター、ガバナンス・フレームワーク

これらの関連語句は、AIエージェントを単なる「流行語」から「工学的システム」へと昇華させるための構成要素です。特にマルチエージェント化の流れは、2026年以降のエンタープライズAI戦略において最も重要なキーワードとなっています。

5. 応用と実践的知識

AIエージェントを実際に組織や個人が導入・活用する際には、技術的な知識だけでなく、戦略的な設計思想とリスク管理の実践的知識が求められます。2026年現在のベストプラクティスに基づき、導入の要諦を詳説します。

5.1 導入戦略:スモールスタートとROIの最大化

AIエージェントの導入は、全社一括のシステム刷新ではなく、特定の「ペインポイント(苦痛な業務)」から開始することが推奨されます。

UiPathの2026年最新レポートでは、AIエージェント導入のROI(投資対効果)を明確にするために、「削減された時間」だけでなく、「業務の品質向上」や「機会損失の防止」を指標に含めるべきだとしています。

5.2 エージェント設計の3原則

- 権限の最小化(Principle of Least Privilege): エージェントには、そのタスクを完了するために必要な最低限の権限(アクセス範囲、決済上限額等)のみを与えること。

- 透明性の確保: エージェントの全行動ログをリアルタイムで保存し、人間がいつでも「なぜその行動をとったか」を遡及できる状態にすること。

- 介入ポイントの設計: 完全に自律させるのではなく、「高額決済の前」「外部送信の前」など、人間が承認を行う「チェックポイント」を設けること。

5.3 技術的課題への対策:ハルシネーションと不確実性

AIエージェントは依然として、確率的に次の言葉を予測するモデルを基盤としているため、エラー(ハルシネーション)の可能性をゼロにはできません。実践的な対策として、以下の「多層防御」が一般的です。

- 自己検証(Self-Correction): 出力結果を別のプロンプトで再検証させる。

- クロスチェック: 異なるモデル(例:GPT-4oとClaude 3.5)のエージェントに同じタスクをさせ、結果を比較する。

- サンドボックス実行: 生成されたコードや操作を、隔離された安全な環境で試行してから本番環境へ適用する。

5.4 組織文化の変革:AIリテラシーから「AIディレクション力」へ

AIエージェントが普及した2026年の労働市場では、単にAIを使う力ではなく、AIエージェントの「上司」として、適切な目標を与え、成果を評価し、改善を促す「ディレクション能力」が求められています。

経済産業省の「未来人材ビジョン」でも指摘されている通り、定型業務が自動化される中で、人間は「課題の発見」と「倫理的判断」という高度な創造的領域にリソースをシフトさせる必要があります。

5.5 将来的展望:フィジカルAIとAGIへの道筋

今後数年間の展望として、AIエージェントはデジタル空間を飛び出し、現実世界での活動を本格化させます。「人工知能基本計画」では、介護ロボットや自動運転車に高度なエージェント知能を搭載する「フィジカルAI」に重点投資が行われています。

また、これら無数の専門エージェントが高度に統合された先に、人間レベルの汎用的な知能を持つ「AGI(汎用人工知能)」の姿が薄らと見え始めています。2026年は、その壮大な進化の過程における「実用化のピーク」として記憶されることになるでしょう。

AIエージェントの実践とは、単にツールを導入することではなく、人間とAIが共生する新しい「業務の標準(スタンダード)」を定義することに他なりません。

6. Q&Aセクション

Q1. AIエージェントを導入すると、従業員の仕事はなくなりますか?

A. 単純な反復業務やデータ処理業務は代替される可能性が高いですが、仕事そのものがなくなるわけではありません。人間は「AIエージェントの管理者・監督者」として、より戦略的な判断や対人コミュニケーション、創造的な課題解決に集中する役割へとシフトします。2026年の日本においては、深刻な労働力不足を補う「救世主」としての側面が強調されています。

Q2. セキュリティ面で、AIエージェントに社内データを読み込ませるのは危険ではありませんか?

A. 適切なガバナンスと技術的対策(プライベートLLM、データマスキング、アクセス制御など)を講じることでリスクは最小化できます。日本政府の「AI事業者ガイドライン」でも、データの安全な取り扱いが最優先事項として挙げられています。また、現在はデータを外部に送信せずに処理する「オンプレミス型・ローカル型AIエージェント」の選択肢も増えています。

Q3. AIエージェントが勝手な判断をして損害を出した場合、誰が責任を負いますか?

A. 2026年現在の法解釈では、原則としてそのAIエージェントを運用している「事業者(企業)」が責任を負います。そのため、重要な意思決定においては「人間による最終承認(Human-in-the-loop)」を組み込む設計が、実務上のスタンダードとなっています。法的な責任所在については、現在も政府のAI戦略会議等で議論が継続されています。

Q4. プログラミングの知識がなくてもAIエージェントを作成できますか?

A. はい、可能です。2026年現在、Googleの「Workspace Studio」やSalesforceの「Agentforce」のように、自然言語(日本語)で指示を出すだけでエージェントを作成・構築できる「ノーコード・エージェント・プラットフォーム」が普及しています。高度なカスタマイズには知識が必要ですが、基本的な業務自動化であれば非エンジニアでも十分に対応可能です。